算法的无形帝国:透视人工智能时代的影响、未来与警示

引言:算法的幽灵与我们的时代

“数字过滤工具拥有塑造政治观点和大众文化的非凡力量。” — 《纽约书评》

我们生活在一个由算法构建的“无形帝国”之中。它没有地理疆界,却在全球范围内行使权力;它没有成文法典,但其规则(代码)却在暗中支配着我们的选择;它的存在无形无影,却深刻地重塑了我们的信息环境、文化景观和政治生态。

这一论断并非危言耸听。三位敏锐的思想家——Renée DiResta、Kyle Chayka 和 David Runciman——已从不同维度揭示了这一帝国的轮廓。DiResta 剖析了算法如何成为虚假信息与政治宣传的温床,侵蚀着我们对“共同现实”的感知;Chayka 描绘了一个被算法“过滤”后的世界,其中文化品味趋于同质与扁平;而 Runciman 则警示,算法正在悄然侵蚀民主政治的根基,加剧社会极化。

本文旨在系统地剖析这个“无形帝国”的运作逻辑。我们将追溯其权力的基石,深入其“统治”的关键领域,展望人机协同的未来图景,并直面其背后的阴影与风险。最终,我们将探讨如何为这个帝国戴上“紧箍咒”,建立有效的治理框架,以确保技术的发展方向与人本主义价值观保持一致,引领我们走向一个更加公平、多元和繁荣的数字未来。

核心探讨方向:

- 算法的力量源泉是什么?

- 它如何在关键领域行使“统治权”?

- 它将把人类引向怎样的未来?

- 我们应如何警惕其风险并建立有效的治理框架?

第一章:算法缘何影响深远:无形帝国的权力基石

算法的巨大影响力并非凭空而来,而是建立在数据、规模、商业模式和技术特性共同构成的坚实基石之上。这四大支柱共同铸就了算法“无形帝国”的权力核心。

1. 数据依赖:帝国的燃料 大数据是算法的命脉。从你的每一次点击、浏览、购物记录到社交关系网络,海量、多维的用户行为数据被持续不断地收集,成为训练和优化算法的“燃料”。算法通过对这些数据的深度学习,构建出精细的用户画像,从而实现对用户偏好乃至欲望的精准预测。这种对数据的无尽渴求,是帝国扩张的根本前提。

2. 规模化与自动化:帝国的铁腕 算法以人类无法企及的速度和规模执行决策。无论是社交媒体上每秒数百万次的内容推荐,还是平台经济中对数千万劳动者的即时调度,算法的自动化决策能力覆盖了社会的各个角落。随着人工智能技术的飞跃,其应用从实验室走向现实,每一次计算能力和数据处理能力的迭代,都让这只“铁腕”的力量呈指数级增长。

3. 商业模式驱动:帝国的引擎 以用户参与度、广告收入和市场份额为核心的商业模式,是驱动算法帝国运转的强大引擎。为了最大化用户停留时间,算法被设计为优先推荐那些最能吸引眼球、激发情绪的内容,而非内容的质量、真实性或长期价值。正如 Kyle Chayka 在其“过滤世界”(Filterworld)概念中指出的,科技公司利用数据驱动的方程来预测甚至操纵用户欲望,最终目的在于攫取商业利润。这使得算法天然地倾向于放大煽动性、极端化和娱乐化的内容。

4. 黑箱特性:帝国的神秘面纱 现代算法,特别是深度学习模型,其内部决策过程极其复杂,往往连其设计者都难以完全解释。这种“黑箱”特性为算法蒙上了一层神秘面纱,形成了技术和认知上的双重壁垒。当算法做出错误或带有偏见的决策时(例如在招聘或信贷审批中),外界很难对其进行有效的监督、审计和问责,使得权力的滥用风险被大大提高。

第二章:算法统治的现状:三大领域的案例剖析

算法的“统治权”已在多个关键领域显现。它不仅改变了商业模式,更在深刻地重塑社会结构与个体体验。

1. 个性化推荐:塑造我们的所见所闻

- 应用现状:从内容平台(如今日头条)、社交媒体(如Facebook),到电商平台和实体零售(如雀巢的订单推荐系统),算法通过精细的用户画像,实现了前所未有的个性化推送。其核心目标是提升用户互动率和商业转化率。

- 文化影响:然而,这种极致的个性化也带来了意想不到的后果。正如 Kyle Chayka 所担忧的,当所有人都被喂食算法认为“你会喜欢”的内容时,文化品味开始趋于标准化和扁平化。我们探索未知、接触异质文化的机会被大大压缩,文化多样性受到侵蚀,世界变得“更加通用和可预测”。

2. 社会舆论:引导公众的所思所想

- 应用现状:借助实时情感分析、主题建模等技术,算法被广泛用于品牌公关、政策效果评估和舆情监控。它能迅速洞察公众对特定事件的态度和情绪倾向。

- 操纵风险:算法在高效分发信息的同时,也成为了操纵舆论的利器。它能轻易放大特定声音,加速信息(包括虚假信息)的病毒式传播。中国中央网信办就曾明确指出算法操纵社会舆论、传播不良信息等乱象。以“河南村镇银行储户被赋红码”事件为例,大数据分析显示,舆情通过社交平台迅速引爆,负面情绪在意见领袖的引领下急剧扩散,这揭示了公众对算法权力滥用风险的高度敏感。

3. 劳动力市场:重构工作的定义与价值

- 替代与创造:AI 对劳动力市场的影响是双重的。一方面,它替代了大量常规性、重复性的任务,如客服、数据录入、流水线作业等。另一方面,它也催生了算法工程师、数据分析师等新兴职业。

- “算法用工管理”:在平台经济中,一种全新的“算法用工管理”模式正在兴起。数据驱动的算法对外卖骑手、网约车司机等进行大规模的自动化管理、派单和绩效评估。这种模式极大地提升了效率,但也带来了新的挑战,如劳动者“物化”、劳动关系难以界定、传统劳动法保护失效等问题。

- 影响范畴:AI 的冲击已从体力劳动延伸至认知和创造性工作。AI绘画工具挑战着平面设计师,AI辅助诊断改变着医生的工作流程,而AI审阅法律文件则在重塑法律行业。工作的定义与价值正在被全面重构。

第三章:人机协同的未来图景:走向共生还是对立?

关于人工智能的未来,与其沉浸于“人类将被完全取代”的末日想象,不如更务实地探讨人机深度协同的共生时代。通用人工智能(AGI)的出现,将可能成为引爆新一轮生产力革命的奇点,但也伴随着巨大的结构性风险。

1. 从“替代”到“协同”的范式转变 未来的主流工作模式,更有可能是人与AI的深度协作。

- AI作为“得力助手”:AI将越来越多地承担重复性、数据密集型的任务,将人类从繁琐的工作中解放出来,使其能专注于创造力、战略规划、情感交互和批判性思维等更高阶的工作。

- “伙伴式”协作:随着技术演进,AI将不再仅仅是被动执行命令的工具,而会成为能够理解人类意图并主动提供支持的“伙伴”。在科研、设计、医疗等复杂领域,人机共同完成任务将成为常态。

2. 通用人工智能(AGI)的黎明与潜在影响

- 定义与预测:通用人工智能(AGI)指具备与人类相当、甚至超越人类的智能水平,能够在广泛领域中学习和解决问题的AI系统。包括OpenAI CEO Sam Altman在内的许多专家预测,AGI可能在2030年前出现。

- 经济变革:AGI被视为全球经济增长的新引擎。高盛预测,AGI在未来十年内可能推动全球GDP增长7%,并显著提升生产力。它将彻底颠覆现有产业,重塑全球经济格局。

- 社会冲击:AGI将对就业市场、教育模式乃至人类生活方式带来颠覆性影响。国际货币基金组织(IMF)警示,全球近40%的就业岗位将受到AI的直接影响,这要求我们必须为大规模的社会结构转型做好准备。

3. AGI发展的风险与挑战 AGI的巨大潜力伴随着同等级别的风险。Google DeepMind在其报告中系统性地梳理了四大核心风险:

- 滥用风险:AGI技术可能被恶意用于发动网络攻击、制造大规模杀伤性武器或进行社会操纵。

- 错位风险:如果AGI的目标与人类的价值观不一致,它在追求自身目标的过程中可能无意或有意地对人类造成伤害。

- 失误风险:高度复杂的AGI系统可能出现无法预料的故障或错误,引发灾难性后果。

- 结构性风险:AGI的普及可能固化或加剧现有的社会不平等,甚至在极端情况下对人类的自主性和生存构成威胁。审慎应对这些挑战,是AGI发展道路上不可回避的课题。

第四章:启示与警示:无形帝国背后的阴影

算法在带来效率与便利的同时,其固有的缺陷和潜在的滥用风险,正在制造一系列严峻的社会问题。这些阴影是对算法帝国不受约束的权力发出的深刻警示。

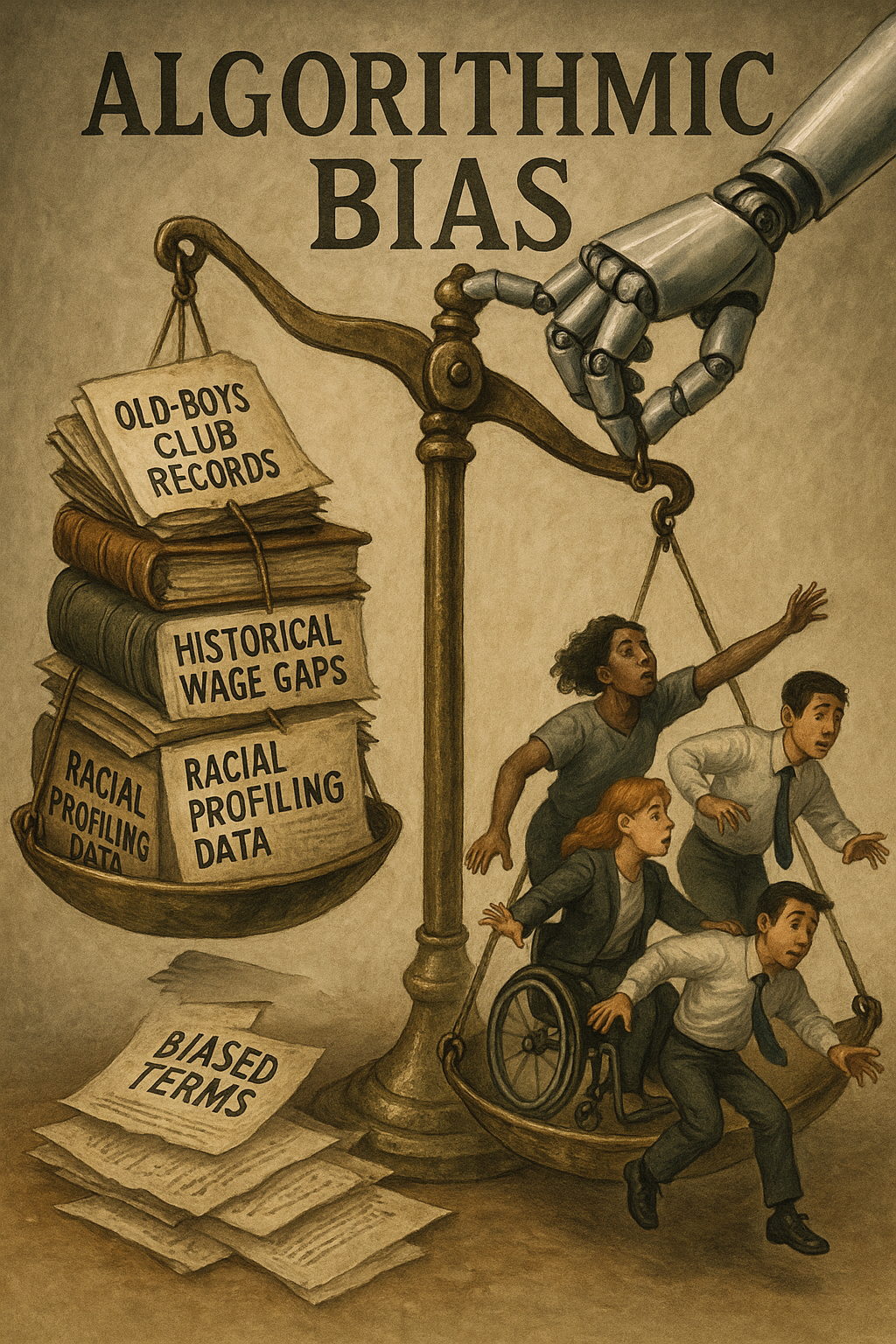

1. 算法偏见:代码中的不平等

- 成因剖析:算法偏见并非源于机器的“恶意”,而是人类社会偏见的数字镜像。它主要来自两个方面:一是带有偏见的训练数据(如历史招聘数据中男性占优),二是存在缺陷的算法模型设计。

- 案例警示:现实世界的案例触目惊心。亚马逊曾因其招聘AI系统性地歧视女性而被迫停用;美国司法系统使用的COMPAS风险评估工具被证实对黑人存在严重偏见;医疗诊断AI在面对少数族裔时,准确率也显著更低。这些“代码中的不平等”正在数字世界中复制甚至放大现实世界的不公。

2. 信息茧房:被算法“投喂”的世界

- 概念溯源:早在2006年,凯斯·桑斯坦(Cass Sunstein)就预言了“信息茧房”的出现——人们只消费自己感兴趣的信息,最终将自己困于一个封闭的认知牢笼中。算法推荐系统极大地加速并强化了这一过程。

- 社会后果:在信息茧房中,人们的认知逐渐窄化,难以接触到多元化的观点,社会共识的基础被侵蚀。这直接导致了群体间的隔阂与对立,加剧了社会极化。这正呼应了David Runciman对算法侵蚀民主政治的深切担忧,当公民活在完全不同的“现实”中时,理性的公共讨论变得几乎不可能。

3. 数字鸿沟:新的社会阶层划分

- 鸿沟的演变:数字鸿沟已从早期的“接入鸿沟”(能否上网)演变为更深层次的“应用鸿沟”(会不会用)和“知识鸿沟”(能否利用数字工具创造价值)。

- 弱势群体的边缘化:老年人、农村居民以及低收入群体,往往因为缺乏数字技能或设备,在享受数字红利(如在线政务、移动支付、网络购物)时面临重重障碍。这种新的不平等,正在加剧甚至固化原有的社会阶层差异。

4. 隐私侵犯与问责缺失

- 根本性冲突:算法对海量数据的渴求,与个人隐私保护之间存在着根本性的冲突。用户的每一次行为都在为算法“帝国”添砖加瓦,但个人数据的边界和权利却日益模糊。

- 问责的困境:当算法造成损害时,谁来负责?是程序员、数据提供方、平台公司,还是算法本身?其“黑箱”特性使得责任难以界定,导致“问责制沉没”(accountability sinks)。建立清晰的算法问责机制,已成为数字治理的核心难题。

第五章:监管与治理之道:为帝国戴上“紧箍咒”

面对算法带来的系统性挑战,全球各国和地区正在积极探索监管与治理的路径。这不仅是一场法律与技术的博弈,更是对未来社会形态的设计。

1. 全球监管模式比较:欧盟 vs. 中国

- 欧盟《AI法案》:欧盟采取了全球首个全面、横向的AI监管框架。其核心是基于风险的方法,将AI应用分为四个等级:

- 不可接受风险(如社会评分系统):完全禁止。

- 高风险(如用于招聘、信贷的AI):实施严格的透明度、数据质量和人类监督要求。

- 有限风险(如聊天机器人):要求履行告知义务。

- 低风险:鼓励自愿遵守行为准则。 该法案具有强大的域外效力,旨在为全球AI治理树立标杆。

- 中国特色监管:中国则采取了更为灵活、纵向、针对性的立法模式。通过出台《算法推荐管理规定》、《深度合成管理规定》等一系列法规,对特定领域和技术进行精准规制。其中,算法备案制度是一项创新举措,要求具有社会动员能力的服务提供者向监管部门备案其核心算法,增强了监管的穿透力。

| 监管模式 | 立法思路 | 监管重点 | 核心机制 |

|---|---|---|---|

| 欧盟 | 横向、全面、基于风险等级的统一法律框架 | 保护基本权利、强调透明度和问责制 | 风险分类、严格的高风险准入要求、域外效力 |

| 中国 | 纵向、针对特定技术和场景的专门法规组合 | 维护国家安全、社会公共利益、强调主流价值导向 | 算法备案制度、安全评估、内容审核 |

2. 技术治理方案:打开“黑箱”的尝试 除了法律监管,技术本身也为治理提供了新的工具。

- 可解释性AI(XAI):XAI(Explainable AI)旨在让AI的决策过程对人类透明、可理解。它并非要完全解构“黑箱”,而是提供一种方式来解释“为何AI会做出如此决策”。XAI对于建立用户信任、满足法规要求、识别并纠正算法偏见、强化最终问责至关重要。

- 其他治理工具:

- 算法影响评估(AIA):在AI系统部署前,系统性地评估其可能对社会、伦理和个人权利带来的潜在影响。

- 数据信托(Data Trusts):探索由独立第三方机构管理个人数据,以在促进数据共享和保护个人隐私之间取得平衡。

- 内部伦理审查:鼓励企业设立跨部门的AI伦理委员会,将伦理考量嵌入产品设计的全流程。

结论:驾驭算法,走向人本主义的未来

算法,这股塑造21世纪的强大力量,无疑是一把锋利的双刃剑。它既是推动社会进步、提升生产效率的引擎,也可能成为侵蚀人类自由、加剧社会不公、稀释文化多样性的“无形帝国”。

回顾全文的分析:

- 我们看到,算法的权力植根于数据、规模、商业模式及其“黑箱”特性(第一章)。

- 我们见证了它如何在个性化推荐、社会舆论和劳动力市场等领域行使着事实上的“统治权”(第二章)。

- 我们展望了人机协同的未来,并警惕通用人工智能(AGI)可能带来的颠覆性冲击与系统性风险(第三章)。

- 我们也直面了算法偏见、信息茧房、数字鸿沟等帝国投下的巨大阴影(第四章)。

人类的未来,取决于我们能否智慧地驾驭这股力量。这并非要求我们抵制技术,而是要主动地为其发展设定方向和边界。前方的道路需要多方协同的努力:

- 技术上,我们需要大力发展可解释性AI(XAI)等“负责任的AI”技术,努力打开算法的“黑箱”。

- 法律上,我们必须借鉴欧盟和中国的实践,继续完善强有力的、适应性的监管框架,为算法戴上法律的“紧箍咒”(第五章)。

- 教育上,提升全民数字素养和批判性思维能力,是抵御算法操纵和打破信息茧房的根本。

- 个人层面,我们需要培养主动探索、跨出舒适区的意识,成为算法的主人,而非被动的消费者。

最终,我们必须回归到那个根本性问题:我们希望技术为一个什么样的社会服务?

我们既是这个“无形帝国”的“臣民”,也理应成为其“立法者”。未来的关键在于,确保技术的发展始终与开放、公平、多元、尊重个体尊严的人本主义价值观保持一致。唯有如此,我们才能驾驭算法,而非被其奴役,共同塑造一个真正由人类智慧引领的数字未来。

参考文献

书籍与核心评论

- Chayka, K. (n.d.). Filterworld: How Algorithms Flattened Culture.

- DiResta, R. (n.d.). Invisible Rulers: The People Who Turn Lies into Reality.

- Runciman, D. (n.d.). 观点来源于《纽约书评》及相关学术访谈中对其关于算法与民主政治影响的论述。

- 《纽约书评》. (2025年10月23日). "Algorithm Nation". (注:此为文章设定的虚构引用)

法规与报告

- 欧洲议会及理事会. 《人工智能法案》(EU AI Act).

- 中华人民共和国国家互联网信息办公室等. 《互联网信息服务算法推荐管理规定》.

- 中华人民共和国国家互联网信息办公室等. 《互联网信息服务深度合成管理规定》.

- 中华人民共和国国家互联网信息办公室等. 《生成式人工智能服务管理暂行办法》.

- Google DeepMind. (n.d.). Report on AGI Risks. (指代相关研究报告)

- 高盛 (Goldman Sachs). (n.d.). Global Economics Analyst Report on Generative AI.

- 国际货币基金组织 (IMF). (n.d.). Staff Discussion Note on AI and the Future of Work.

部分网络文献与数据来源

- "AI Agent是通往AGI路上的“iPhone时刻”吗?". (2023). Jiemian.

- "A New AI Act in the Making: What is the EU Artificial Intelligence Act?". (2024). Bird & Bird.

- "China’s generative AI regulations and how they compare". (2024). King & Wood Mallesons.

- "Chinese regulators release new rules on generative AI". (2023). Jun He Law Offices.

- "COMPAS and the Competing Demands of Fairness". (n.d.). IBM.

- "Deepfakes and deep synthesis: China’s regulatory approach". (2023). AllBright Law Offices.

- "Digital divide". (n.d.). IBM.

- "European Union AI Act". (2024). Wikipedia.

- "Explainer: The EU AI Act". (n.d.). European Parliament.

- "Filter Bubbles and Echo Chambers: The new challenges of social networks". (n.d.). Feishu.

- "How does AI impact the labor market?". (2024). Salesforce.

- "The Algorithm Accountability Act of 2022". (2022). China Law Insight.

- "What Is Algorithmic Bias?". (n.d.). IBM.

- "What is explainable AI (XAI)?". (n.d.). IBM.

- “《互联网信息服务算法推荐管理规定》答记者问”. (2022). 国家互联网信息办公室.

- “河南部分村镇银行储户被赋红码”事件相关舆情分析报告. (2022).

- “人工智能如何影响未来就业”. (2023). 中国经济50人论坛.

- “人工智能时代下“人机协同”的几种工作方式”. (2024). 163.com.

- “深度学习在社会舆论分析中的应用”. (n.d.). CSDN.

- “数据驱动的舆情研究:方法、主题和展望”. (n.d.). FanRuan.

- “数字鸿沟研究现状综述”. (2023). Hans Pub.

- “算法推荐系统概述”. (2023). Linkflow.

- “算法推荐在社会舆论场中存在哪些乱象?中央网信办有关负责人这样说”. (2021). 天津市人民政府.